15.06.2020

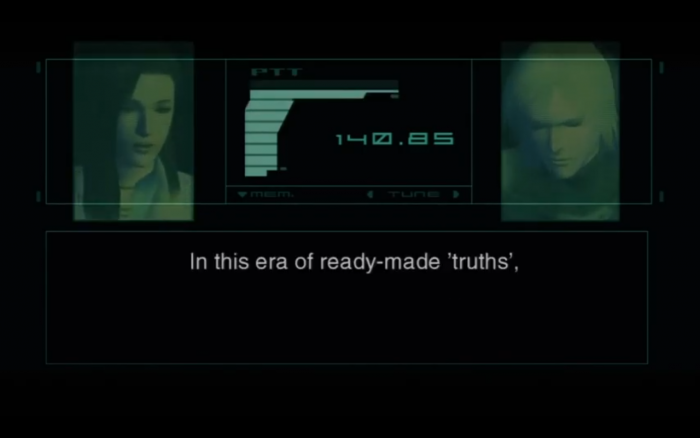

Desde los paisajes digitales diseñados para el videojuego «Metal Gear Solid 2», el artista Lucas Lugarinho apuesta por las «verdades ready-made» como estrategias para jugar con imágenes que, ante las fake news y los datos capitalizables, revisen las ficciones que desde el pixel se nos presentan.

I

Cuando se lanzó el juego de espionaje táctico Metal Gear Solid 2: Sons of Liberty de Playstation 2 en 2001, el rol que jugaría el Internet seguía siendo difuso. En ese entonces, la interacción de lxs usuarixs de las redes globales del nuevo milenio se limitaba a la discusión de la ficción y la especulación en foros especializados en diversos temas. Al incursionar dentro de las herramientas de creación de imágenes ofrecidas por la posibilidad visual de los píxeles en una pantalla, se podría argumentar que la web 1.0 se utilizaba principalmente como un centro para la experimentación estética y funcional de imágenes y narrativas; tierra donde reinaba la ficción suprema. Desde entonces, esta «tierra de nadie» ha sufrido un rápido proceso de colonización, siendo ocupada por corporaciones multimillonarias. A medida que la tecnología y la accesibilidad comenzaron a rediseñar la interacción web, esta antigua tierra de ficción se proclamó como un nuevo reino de la realidad. Construidas sobre sus ruinas de mitos había plataformas monopólicas que ahora albergan la mayoría de los imaginarios existentes en el mundo a través de la explotación extractiva.

El director del MGS2, Hideo Kojima, parecía estar consciente de la inevitable instrumentalización de los espacios virtuales; en consecuencia, proliferando tanto verdades como engaños, al tiempo que dicta la realidad a través de nuestra creciente dependencia a algoritmos sesgados [1] que se esconden detrás de las pantallas cristalinas. Casi al final del juego —durante un diálogo en escena con su comandante—, Raiden (el protagonista utilizado por lx jugadorx) se encuentra a sí mismo siendo manipulado por inteligencias artificiales que le ordenan cumplir con distintos deberes políticos de espionaje. Con el fin de explicar sus motivaciones para controlar y censurar la información que accede a Internet, las IA en cuestión comentan las cantidades abismales de datos desechables generados por sus usuarios: datos de un solo uso que se acumulan y reorganizan de varias maneras, siempre a conveniencia de la realidad singular de lx espectadorx, cristalizando[se] [como] verdades para lxs espectadores no críticxs (a conveniencia de sus realidades singulares). En la versión del juego en inglés, éstas son referidas como ready-made truths, traducción creada años antes de la popularidad de las fake news, las cuales apenas captaron el interés público tras su impacto en recientes elecciones. Como parte de la narrativa del videojuego, las IA proceden a explicar cómo su interferencia en el orden ‘natural’ de las ecologías digitales puede reunir a un país entero bajo el letrero del progreso, finalmente terminando una era de decadencia moral y la descentralización de creencias en común.

No es sorpresa que, desde principios de esta década, vivimos en un estado de emergencia relativo a la desinformación; luchando por encontrar consenso sobre eventos reales mientras que la data basura acelera la siguiente desestabilización de organizaciones políticas y sociales del capitalismo tradicional

El logro de la localización del MGS2, manejado en su mayoría por el traductor anglo-japonés Agness Kaku, fue para atender una analogía a las problemáticas de información actuales, a través de un lente no sesgado y terminología moderna. No es sorpresa que, desde principios de esta década, vivimos en un estado de emergencia relativo a la desinformación; luchando por encontrar consenso sobre eventos reales mientras que la data basura acelera la siguiente desestabilización de organizaciones políticas y sociales del capitalismo tradicional —un disturbio que probablemente se contrarrestará continuamente con más políticas austeras que valoran la materia sobre la vida. Pero para ser justxs, ¿no es el nombre fake news favorable a este proceso, al celebrar la dicotomía entre lo verdadero y lo falso en un espacio cuyos cimientos fueron dedicados a la ficción, y especialmente cuando tomamos en cuenta el crecimiento exponencial y la sofisticación de técnicas de postproducción como las deepfakes? [2]

Pensando en esta cuestión, el presente texto propone la adopción de la terminología verdades ‘ready-made’ presentada en MGS2: un nombre que, creo, designa con precisión la naturaleza de esta data, y evoca la práctica avant-garde del ready-made introducido por Marcel Duchamp hace más de 100 años. Para explicar el propósito de esta nueva nomenclatura, hay que analizar la importancia de las verdades ‘ready-made’ como medio de resistencia y agenciamiento de una persona sobre su imaginación, para acceder viralmente a otrxs, así como la reciente armamentización informativa por parte de los enormemente descentralizados portales de noticias.

II

Habiendo existido desde el nacimiento de la vida social, la desinformación no es cosa nueva. Sin embargo, observándola desde otra perspectiva, podríamos decir que la lucha entre una realidad homogénea, sostenida por una creencia designada y centralizada, contra una plétora de células disidentes del conocimiento de la resistencia etiquetadas como ficción, ha tenido un rol central en la historia de las sociedades organizadas. Persecuciones religiosas de otras creencias, medicinas, ciencias, la categorización de personas sanas y enfermas, el derecho al nacimiento divino creado por los mismos reyes y la propaganda política contemporánea, todo tiene una cosa en común: la instrumentalización de imágenes por un status quo socialmente organizado (como reinos, estados, e iglesia), con el fin de alcanzar el monopolio sobre la imaginación local y proceder a manejar sus recursos. Respecto a esto, el concepto de desinformación se vuelve peligrosamente maleable, permitiendo que los imaginarios populares sean igual de explotables que los recursos naturales bajo la misma vieja lógica cartesiana que fragmenta nuestra interdependencia dentro del lugar que habitamos, ya sea virtual o físico. Según el periodista Steven Poole,

«En su Novum Organum (1620), el filósofo Francis Bacon describe por primera vez el fenómeno psicológico que explica gran parte de nuestras preocupaciones modernas sobre la confianza y la verdad —lo que después se bautizaría como sesgo de confirmación. Nuestras mentes, apunta, tienden a dar más peso a lo afirmativo (o positivo) que a los resultados negativos, por lo que es sencillo que una persona ‘aproveche con entusiasmo cualquier dato, por muy débil que este sea, que apoye su teoría; pero cuestione, o ignore, según su conveniencia, los hechos que la desmientan’ ”. [3]

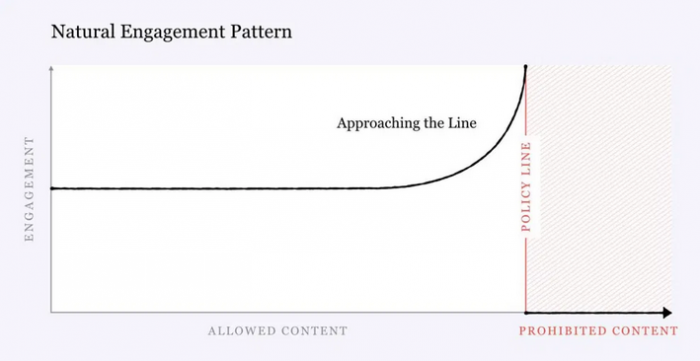

Por encima de esto, el contenido límite o al límite —medios que prácticamente violan las líneas políticas (como desinformación, discursos de odio, violencia, intimidación, clickbait)— se convirtió en el contenido más atractivo del Internet; proporcionando una fuente de ganancias poco éticas para las redes sociales. Esta estrategia fácilmente se compara con la corrupción de los ecosistemas: la extracción de recursos que degrada los enlaces necesarios para coexistir. Este principio de contenido límite es utilizado frecuentemente en los medios de ficción, como lo son la sobreexplotada cantidad de plot twists planeados para atraer a lxs espectadorxs. Pero en el caso de MGS2, el director Hideo Kojima utiliza contenido límite como herramienta crítica.

Recientemente, dentro de sus videos en retrospectiva de Metal Gear, el Youtuber ThorHighHeels destacó que Metal Gear Solid 2 es una burla. En resumen, Thor especula que Kojima designó al juego como un meta comentario al personaje fanboy/otaku: entusiastas mediáticos atados fanáticamente a las imágenes que consumen. Mientras se producía la secuela, con el objetivo de capitalizar el éxito del primer MGS, y en contra de las intenciones de Kojima, creó una secuela narrativa para engañar a lxs jugadorxs; mostrando un tráiler de nueve minutos hecho de material falso durante la E3 [4] en el año 2000.

No es difícil notar el tono de burla dentro de la narrativa del juego actual mientras Raiden —protagonista desconocido e inesperado que toma el lugar del gran Solid Snake— es constantemente ridiculizado: pisando heces de pájaro, viéndose forzado a recorrer segmentos del mapa desnudo, e incluso siendo malgenerizado. Es un protagonista no agradable a los ojos del fanboy regular. La historia continúa mientras, dados los eventos de la primera instalación de la franquicia MGS, el protagonista previo, Solid Snake, hace uso de redes globales para esparcir data clasificada sobre el proyecto Metal Gear, una esque-gundam-máquina-de-guerra-de-desarrollo-e-investigación-de-la-Guerra-Fría que sirve como dispositivo principal de la franquicia. Estas fugas, comparadas por HighHells al trabajo de Julian Assange en Wikileaks, ponen los eventos de MGS2 en movimiento, donde el gobierno le otorga a Raiden la tarea de detener a Snake con la excusa de que ahora es un héroe convertido en terrorista que ha invadido una instalación de limpieza en alta mar. La historia continúa con ambxs, Raiden y lx jugadorx, descubriendo las inconsistencias de la simulación construidas alrededor, culminando en el diálogo de las IA que preceden al clímax final del juego.

[…] verdades individuales micro dirigidas incentivan desacuerdos digitales, fragmentando nociones de reinado y pertenencia al explotar un aspecto inherente a las imágenes que es conocido por la historia del arte y Duchamp mismo: la especulación.

Dejando a un lado la ingenuidad política de la historia, podría decirse que el juego aprovecha su punto de vista al explotar las creencias y expectativas de sus fanáticxs para comentar sobre la naturaleza manipuladora de los medios. Dicho acercamiento al diseño del juego evoca ciertos paralelismos con los ready-mades de Duchamp, donde el artista desarrolló piezas difíciles de digerir en aquel tiempo al tomar en cuenta sus ajustes, espectadorxs, y las implicaciones históricas y poéticas de sus materiales industrializados —generando una discusión alrededor del canon establecido en el mundo del arte. Mientras que las provocaciones no racionales de Duchamp servían como crítica a la legitimación establecida sobre los procesos artísticos, en MGS2, Kojima cuestiona las creencias de lxs jugadorxs fandoms —gente fanáticamente devota a los medios que consumen, y a la que generalmente se le otorga la libertad de ejercer cualquier método a su disposición con el pretexto de encarnar a un héroe. En ambos casos, este trabajo invita a lxs espectadorxs a obtener agencia de su propia imaginación y a inyectar una dosis de ficción crítica dentro de las realidades establecidas por sus medios [(y sí) (¿) el arte se viera así (?) / (y sí) (¿) los juegos se jugaran así (?)]. Sin embargo, esta cuestión, alcanza una dimensión totalmente nueva cuando, en lugar de asumirse abiertamente como ficticia, un medio diseñado la posee como simulacro de la realidad, al igual que con los portales nuevos.

Lo que hacen los ready-mades del MGS2 de Kojima y Duchamp es, de cierto modo, utilizar sus medios para jugar con los imaginarios —ya sesgados— de sus usuarixs, al traicionar su deseo ocularcéntrico. Pero en contraste a este acercamiento, la mayoría de lxs agentes de las fake news diseñan contenido al límite con el fin de apelar y transformar creencias preestablecidas. Dentro de la historia de MGS2, el gobierno auto-creado y controlado por IA dirige la información del Internet para mantener una opinión pública homogénea. Sin embargo, lo que realmente observamos hoy en día es una continua y multifacética guerra de imágenes donde viejos monopolios occidentales no logran un consenso favorable. En su lugar, verdades individuales micro dirigidas incentivan desacuerdos digitales, fragmentando nociones de reinado y pertenencia al explotar un aspecto inherente a las imágenes que es conocido por la historia del arte y Duchamp mismo: la especulación.

III

El campo de batalla contemporáneo entre bots y minions de la guerra mediática es un reflejo directo de las dificultades iniciales que las industrias culturales enfrentaron al intentar lucrar vía este NUEVO mundo del Internet —especialmente a través de la piratería. Fueron los canales nuevos los que principalmente lucharon contra el fenómeno de la descentralización, mientras las redes sociales prometían ser una manera efectiva para (re)organizar a la gente sin necesidad de consultar medios de opinión. Cuando aún no se establecía el primer monopolio de plataformas billonarias, que actualmente atraen el mayor tráfico del Internet, surgieron canales nuevos que intentaron posicionarse como árbitros de la verdad, luchando contra el enemigo de verdades piratas no verificadas, las fake news. [5] Pero la marea ya había cambiado nuestra relación con la realidad para que sus esfuerzos realmente dieran frutos.

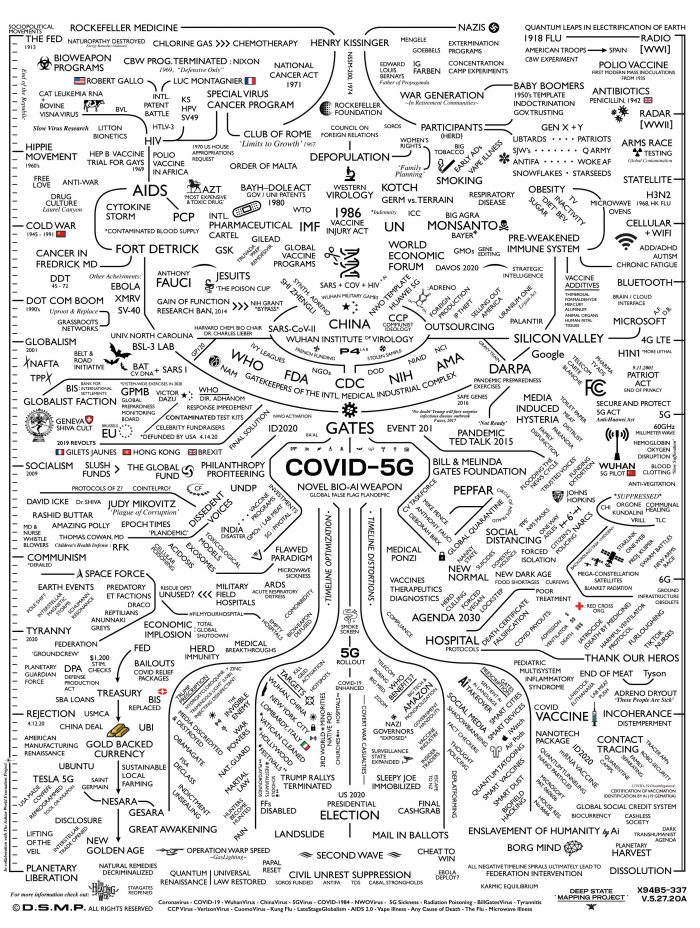

A diferencia de otros gigantes mediáticos, que rediseñaron exitosamente la manera en la que consumimos arte y ficción hoy en día (Sp*tify, N*tflix, Am*zon, por mencionar algunos), los conglomerados de noticias aún tienen que superar las micro-realidades de las comunidades en Internet —lxs usuarixs que se unen para arruinar los sesgos de confirmación de lxs demás, y que frecuentemente se organizan como militantes de las verdades ‘ready-made’ conspirando contra narrativas establecidas. [6] Mientras que los medios más grandes utilizaban su alcance y sobreabundancia de data a favor de sus agendas y narrativas, lxs usuarixs inconformes comenzaron el mismo proceso de manera similar, sólo que utilizaron imágenes enterradas bajo las verdades impuestas. Más que piratear noticias, estas guerrillas de la ficción empoderan sus perspectivas del mundo con verdades ‘ready-made’ extraídas de la base de datos. Con el fin de utilizar como armas dicha data, lxs agentes inyectan especulación en memes, testimonios e imágenes re-contextualizadas para verse involucradxs en una guerra cultural, del tipo Gramsciana, por los recursos de la imaginación de lxs usuarixs del Internet. La contra-producción de información funciona como medio de resistencia y propagación de ideologías, donde la lucha entre las verdades anti-hegemónicas y establecidas está constantemente colonizando y descolonizando los paisajes digitales y sus imaginarios políticos adjuntos.

De cierta forma, los ready-mades de Duchamp se asemejan al fenómeno de las fake news: ambas siendo montajes radicales de comodidades (objetos y data) que cuestionan de manera explícita a la imposición hegemónica de la realidad. Dicha coyuntura podría sonar a que las verdades ‘ready-made’ son armas revolucionarias efectivas, pero, al igual que en el mundo físico, lxs militantxs digitales a menudo (y fácilmente) se ven cooptadxs por mayores esquemas; trátese de singularidades algorítmicas, disturbios corporativos o blanqueo político. [7] Lo mismo se percibe al ver cómo envejecieron los ready-mades de Duchamp, convirtiéndose en un canon y una representación de lo inalcanzable que es el mundo del arte.

Las guerrillas digitales —de bots humanxs o algorítmicos— a menudo diseñan y enmarcan información con el objetivo de competir en cuestión de métricas de “éxito” y productividad dentro de las redes sociales (likes, shares, suscripciones) que, en retorno, atestan a la verdad sobre una opinión, hecho editado o perspectiva a sus observantes. El valor del diseño sobre los hechos siempre ha estado a favor de la guerra como lo argumenta Susan Sontag en su libro Regarding the Pain of Others [8] y que actualmente se demuestra por el hecho de que las redes sociales no curan su contenido con base en la legitimidad o veracidad, sino que muestran los medios de interacción más esperados en función de la popularidad. Sin embargo, este aspecto ahora se ha permeado en la mayor parte de nuestra experiencia en la web: desde anuncios spam sobre cómo obtener un pito más grande, a fotografías de incendios forestales de hace diez años, pasando por burlas sobre los tuits presidenciales. Lo que las fake news evidencian es cómo las imágenes se crean para luchar, no por la verdad sobre la realidad, sino por nuestra atención al volverlas más claras, sensuales, peligrosas, coloridas: portales engañosos a mundos aún más nuevos, o recordatorios de aquellos que ya tenemos en nuestras mentes. Al igual que el nombre de las Fine Arts, o en el caso de los juegos el título de AAA, dentro del nombre fake news reside un arma de homogeneización que necesita ser discutida a favor de un plan de coexistencia a largo plazo dentro de un mundo en constante fragmentación (visual).

IV

Este texto no está a favor de la desinformación de ninguna manera, es más bien una propuesta sobre un nuevo acercamiento hacia las pantallas que mantienen los enlaces necesarios entre sí. Ya que, escondidas detrás de la luz que toca nuestros ojos, las imágenes brillantes de las pantallas digitales también eligen sus sombras en forma de anuncios y especulación. La verificación digital de hechos e información apenas puede cubrir el impacto de la desinformación en usuarixs sesgadxs: y si lo hiciera, funcionaría como herramienta de homogeneización, tal como las bases de usuarixs rechazan a ciertos medios que van en contra de sus creencias. Dentro de las verdades ‘ready-made’ se encuentra una estrategia de juego con las imágenes, en lugar de utilizarlas como armamentos. Es una manera de conectar, no de extraer ni instrumentalizar.

Lo que estos tiempos contemporáneos han logrado escenificar exitosamente es un mundo donde lxs humanxs son mediadxs a través de pantallas, donde la soberanía y la realidad son discutidas a través de un medio cuya luz apunta hacia nuestros deseos individuales, en vez de conectarnos como comunidad —escenario donde reina el desacuerdo. No obstante, tal vez podamos comenzar a repensar este paradigma fácilmente; una concordancia histórica y social que remonte a generaciones, creencias y culturas, sin importar sus estándares tecnológicos occidentales o la complejidad de su folklore. Una estrategia iconoclasta vestida de centrismo ocular.

La creencia que todx usuarix de la red asume ser verdad al mirar una pantalla digital, como al leer este texto, por ejemplo, es la idea de que una imagen es real. Con esto en mente, podemos presumir que para trazarnos nuevos links de coexistencia necesitamos entender la soberanía de las imágenes como seres cambiantes, no como recursos. Necesitamos enlazarnos a las imágenes para nutrir conexiones alternativas entre nosotrxs, dentro de las múltiples dimensiones que habitamos.

—

Este texto es uno de los seleccionados a través de nuestra convocatoria.

—

El texto fue traducido del inglés al español por Irene Trejo.

Los algoritmos sesgados son la base del aprendizaje automático. Son lo que impulsa a las máquinas inteligentes a tomar decisiones examinando los diferentes tipos de sesgos que se encuentran más comúnmente en los conjuntos de datos al identificar, por ejemplo, datos históricos o estereotipos que ya existen en la sociedad según la hegemonía.

Los deepfakes son medios sintéticos que reemplazan la semejanza de una persona en una imagen o video original con el de otra persona, con fines engañosos o de entretenimiento. El término deepfake fue acuñado en 2017 por usuarios de reddit en subforos dedicados a implementar redes neuronales para mejorar los algoritmos de visión por computadora capaces de generar contenido pornográfico a semejanza de personas famosas, a manera de memes u otras formas de medios de entretenimiento. La naturaleza altamente engañosa de esta tecnología plantea un desafío para el futuro de la comunicación digital y la política.

Steven Poole, “Before Trump: the real history of fake news”, en The Guardian, 2 de noviembre de 2019

La Electronic Entertainment Expo, también conocida como E3, es un evento mundial de tres días de duración en la ciudad de Los Ángeles para juegos de computadora y video y productos relacionados.

La explotación de la sobreabundancia de datos es una táctica ampliamente utilizada por las milicias de las verdades ‘ready-made’, pero esta estrategia ha sido utilizada por los monopolios de los medios durante mucho tiempo: los conglomerados de noticias acaban de rediseñar las tecnologías antipiratería en algoritmos de ingeniería social. La industria de la música, por ejemplo, ha sido pionera en el método de envenenamiento de contenido, la práctica de compartir datos corruptos en servidores, con la esperanza de que lxs usuarixs se desanimen a piratear archivos contaminando sus redes para luego predicar sobre la naturaleza insegura de estos ciberespacios. Hoy en día, los canales de noticias tienen un gran interés en temas como la regulación de noticias falsas y todos los escándalos relacionados con la desinformación en la web, ya que las redes sociales se convirtieron para los portales de noticias en lo que Piratebay es para las industrias del entretenimiento.

Es importante tener en cuenta que los sesgos de confirmación también son responsables de la idea de que sólo la «otredad» maneja tácticas tales como información falsa. Por ejemplo, la narrativa de la Tierra plana que establece que las imágenes del espacio exterior son creadas por programas espaciales gubernamentales como la NASA. Pero a pesar de la inclinación política o religiosa, las milicias de la verdad operan dentro de una amplia gama de grupos socio-virtuales, incluidos aquellos a los que lx lectorx podría sentirse afiliadx: desde adolescentes adoctrinadxs por extremistas de la ultraderecha que fungen como streamers de Twitch, hasta clubes online de libros comunistas izquierdistas. Creo que la pregunta radica más en una praxis de confirmación en torno a la información sesgada que a un dilema moral o ético. Por ejemplo, estas dos noticias sesgadas de opiniones políticas de izquierda y derecha en Brasil: fake news del ala derecha

Vale la pena mencionar que, en las vastas redes que filtran verdades ‘ready-made’, existen numerosos agentes, tanto físicos como virtuales, que tienen roles cruciales en la difusión (incorrecta) de la información. Lo que se remonta a las bromas de verdad de 4chan sobre las páginas de Wikipedia, se ha convertido en una subindustria propia, con casos como el escándalo electoral de Cambridge Analytica. Las organizaciones especializadas en datos agrícolas para difundir verdades ‘ready-made’ han actualizado las viejas estrategias de publicidad política para definir mejor sus objetivos, pero es importante notar el papel continuo de las bases de usuarixs más jóvenes y mayores en estos esquemas, principalmente debido al desconocimineto de ambos grupos sobre cómo la tecnología que utilizan cosecha su imaginación. Ver más

Ver más en Susan Sontag, Regarding the Pain of Others (Nueva York: Picador, 2003), p.43: “No debería sorprender entonces que muchas imágenes canónicas de las primeras fotografías bélicas hayan resultado trucadas o que sus objetos hayan sido amañados. Después de llegar al muy bombardeado valle en las proximidades de Sebastopol en un cuarto oscuro tirado por caballos, Fenton hizo dos exposiciones desde idéntica posición del trípode: en la primera versión de la célebre fotografía que tituló «El valle de la sombra de la muerte» (a pesar del título, la Brigada Ligera no emprendió su fracasada carga en este paraje), las balas de cañón se acumulan en el suelo a la izquierda del camino, pero antes de hacer la segunda foto —la que siempre se reproduce— vigiló que las balas de cañón se dispersaran sobre el camino mismo. Una de las fotos de un sitio desolado donde en efecto había habido muchos muertos, la imagen que hizo Beato del devastado palacio Sikandarbagh, supuso un arreglo mucho más minucioso de su asunto, y fue una de las primeras representaciones* fotográficas de lo horrendo en la guerra.”

Comentarios

No hay comentarios disponibles.